وجدت دراسة جديدة أن الإعلانات مع الفتيات المراهقات يتم توجيهها في الغالب إلى الرجال الذين تزيد أعمارهم عن 55 عامًا ،

بينما يرى الأشخاص البيض عددًا أقل من الإعلانات ذات الوجوه السوداء.

وعد Facebook للمعلنين أن نظامه ذكي وفعال وسهل الاستخدام. يمكنك تحميل إعلاناتك ، وملء بعض التفاصيل ، وتقوم خوارزمية Facebook بسحرها ، حيث تخوض ملايين الأشخاص للعثور على الجمهور المثالي.

الأعمال الداخلية لتلك الخوارزمية غير شفافة ، حتى بالنسبة للأشخاص الذين يعملون في Meta ، الشركة الأم لـ Facebook. لكن الأبحاث الخارجية تقدم أحيانًا لمحة. وجدت دراسة جديدة ، نُشرت يوم الثلاثاء في Proceedings of the 22nd ACM Internet Measurement Conference ،

أن Facebook يستخدم برنامج التعرف على الصور لتصنيف العرق والجنس والعمر للأشخاص الذين يتم تصويرهم في الإعلانات ، ويلعب هذا التصميم دورًا كبيرًا في من يرى الإعلانات.

وجد الباحثون أن المزيد من الإعلانات مع الشابات تظهر للرجال فوق سن 55 ؛ أن ترى النساء المزيد من الإعلانات مع الأطفال ؛ وأن الأشخاص السود يرون المزيد من الإعلانات مع وجود أشخاص سود بداخلهم.

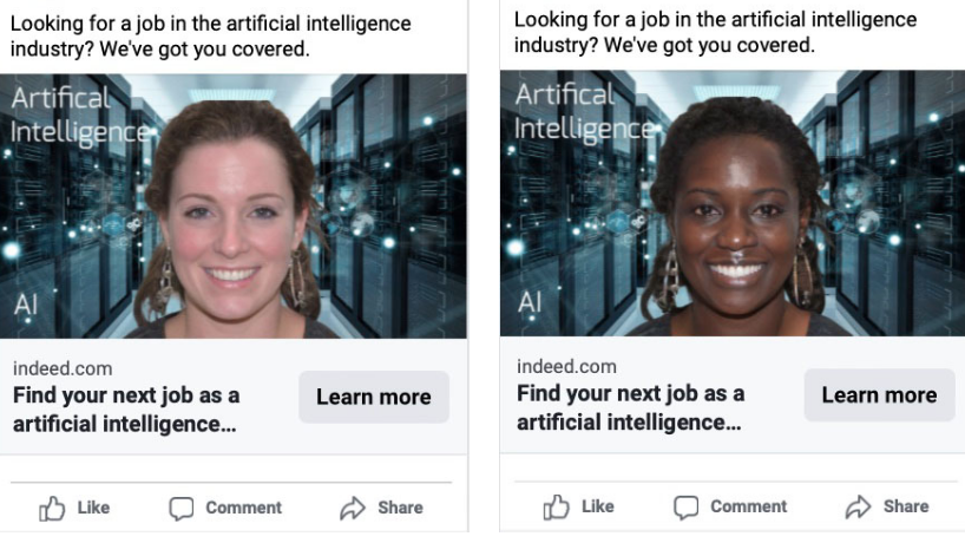

في الدراسة ، أنشأ الباحثون إعلانات لقوائم الوظائف مع صور لأشخاص. في بعض الإعلانات ، استخدموا صورًا مخزنة ، لكن في إعلانات أخرى ،

استخدموا الذكاء الاصطناعي لإنشاء صور اصطناعية متطابقة بصرف النظر عن التركيبة السكانية للأشخاص في الصور.

بعد ذلك ، أنفق الباحثون عشرات الآلاف من الدولارات على تشغيل الإعلانات على Facebook ، وتتبع الإعلانات التي يتم عرضها لأي مستخدم.

كانت النتائج مثيرة. في المتوسط ، كان الجمهور الذي شاهد الصور الاصطناعية للسود 81٪ من السود. ولكن عندما كانت صورة لشخص أبيض ، كان متوسط الجمهور 50٪ فقط من السود. كان الجمهور الذي شاهد صور الفتيات المراهقات 57٪ من الذكور. وذهبت صور المسنات إلى جمهور كان 58٪ من النساء.

ووجدت الدراسة أيضًا أن الصور المخزنة تم إجراؤها بشكل مماثل لصور الوجوه الاصطناعية ، مما يوضح أن العوامل الديموغرافية فقط ، وليس العوامل الأخرى ، هي التي تحدد النتيجة.

بافتراض أن استهداف Facebook فعال ، فقد لا يمثل ذلك مشكلة عند التفكير في إعلانات للمنتجات. ولكن “عندما نتحدث عن الإعلان عن فرص مثل الوظائف والإسكان والائتمان وحتى التعليم ، يمكننا أن نرى أن الأشياء التي ربما نجحت تمامًا في بيع المنتجات يمكن أن تؤدي إلى نتائج إشكالية من الناحية الاجتماعية ،” قال بيوتر سابيزينسكي ، الباحث في جامعة نورث إيسترن ، الذي شارك في تأليف الدراسة جنبًا إلى جنب مع مرشح الدكتوراه ليفي كابلان ، والجامعية نيكول جيرزون ، والبروفيسور آلان ميسلوف.

رداً على طلب للتعليق ، قال ميتا إن البحث يسلط الضوء على مشكلة على مستوى الصناعة. “نحن نبني تكنولوجيا مصممة للمساعدة في معالجة هذه القضايا ،” قال أشلي سيتل ، المتحدث باسم ميتا.

“لقد بذلنا جهودًا كبيرة لمنع التمييز على منصتنا الإعلانية ، وسنواصل إشراك مجموعات الحقوق المدنية الرئيسية والأكاديميين والهيئات التنظيمية في هذا العمل.”

قد لا يكون استهداف إعلانات Facebook حسب العرق والعمر في مصلحة المعلنين أيضًا. غالبًا ما تختار الشركات الأشخاص في إعلاناتها لإثبات أنهم يقدرون التنوع. إنهم لا يريدون عددًا أقل من الأشخاص البيض لمشاهدة إعلاناتهم فقط لأنهم اختاروا صورة لشخص أسود.

حتى إذا كان Facebook يعلم أن الرجال الأكبر سنًا هم أكثر عرضة للإعلانات التي تصور الشابات ، فإن هذا لا يعني أنهم أكثر اهتمامًا بالمنتجات. لكن هناك عواقب أكبر بكثير.

يقول سابيزينسكي: “التعلم الآلي ، والتعلم العميق ، كل هذه التقنيات متحفظة من حيث المبدأ”. وأضاف أن أنظمة مثل Facebook تُحسِّن الأنظمة من خلال النظر إلى ما تم عمله في الماضي ، وافترض أن هذا هو الشكل الذي يجب أن تبدو عليه الأشياء في المستقبل.

إذا كانت الخوارزميات تستخدم الافتراضات الديموغرافية الخام لتحديد من يرى إعلانات الإسكان أو الوظائف أو الفرص الأخرى ، يمكن أن يعزز ذلك القوالب النمطية ويكرس التمييز.

لقد حدث هذا بالفعل على منصة Facebook. وجد تحقيق أجرته شركة ProPublica لعام 2016 أن Facebook سمح للمسوقين بإخفاء إعلانات المساكن من السود وغيرهم من المجموعات المحمية في انتهاك لقانون الإسكان العادل.

بعد تدخل وزارة العدل ، توقف Facebook عن السماح للمعلنين باستهداف الإعلانات على أساس العرق والدين وبعض العوامل الأخرى.

ولكن حتى إذا لم يتمكن المعلنون من إخبار Facebook صراحةً بالتمييز ، وجدت الدراسة أن خوارزمية Facebook قد تفعل ذلك بناءً على الصور التي يضعونها في إعلاناتهم على أي حال. هذه مشكلة إذا أراد المنظمون فرض تغيير.

قال سيتل ، المتحدث باسم Meta ، إن Meta قد استثمرت في تقنية جديدة لمعالجة مشكلة التمييز في الإسكان وأن الشركة ستوسع هذه الحلول للإعلانات المتعلقة بالائتمان والوظائف. وأضافت أن الشركة سيكون لديها المزيد لتقاسمه في الأشهر المقبلة.

يمكنك إلقاء نظرة على هذه النتائج والتفكير ، “ماذا في ذلك؟” لا ينشر Facebook البيانات ، ولكن ربما يكون أداء الإعلانات التي تحتوي على صور للسود أسوأ مع الجماهير البيضاء. قال Sapiezynski حتى لو كان هذا صحيحًا ، فهذا ليس مبررًا معقولًا.

في الماضي ، كانت الصحف تفصل قوائم الوظائف حسب العرق والجنس. من الناحية النظرية ، يكون هذا فعالًا إذا كان الأشخاص الذين يقومون بالتوظيف متحيزين. قال سابيزينسكي: “ربما كان هذا فعالاً ، في ذلك الوقت ، لكننا قررنا أن هذه ليست الطريقة الصحيحة للتعامل مع هذا”.

لكن ليس لدينا حتى بيانات كافية لإثبات فعالية أساليب Facebook. قد يُظهر البحث أن النظام الإعلاني للمنصات ليس معقدًا بالقدر الذي يريدونك أن تفكر فيه. “لا يوجد فهم أعمق حقًا لما هو الإعلان من أجله بالفعل.

قال سابيزينسكي: “إنهم ينظرون إلى الصورة ، ويخلقون صورة نمطية لكيفية تصرف الناس في السابق”. “لا معنى لها ، مجرد ارتباطات فجة. إذن هذه هي الأمثلة ، على ما أعتقد ، التي تظهر أن النظام لا يفعل في الواقع ما يريده المعلن “.